在 Coco-AI 最早的版本就提供了接入 Google drive 的视频,今天我终于实现了,而且借着全图形化的优势更加方便了。

参考这个文档新建 google SSO(好像也没啥参考性)

https://developers.google.com/workspace/drive/api/quickstart/go?hl=zh-cn

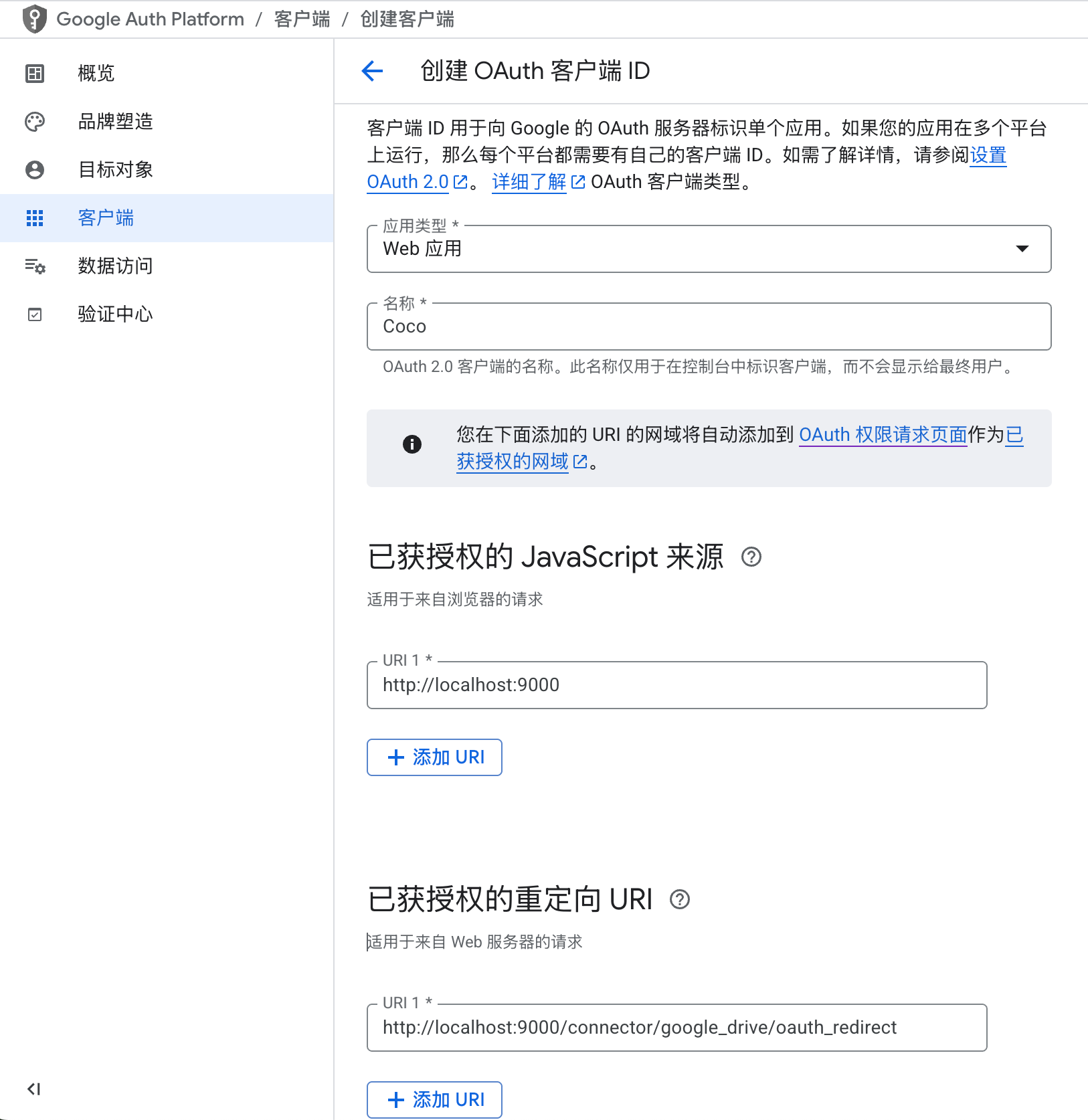

创建客户端

填入信息,

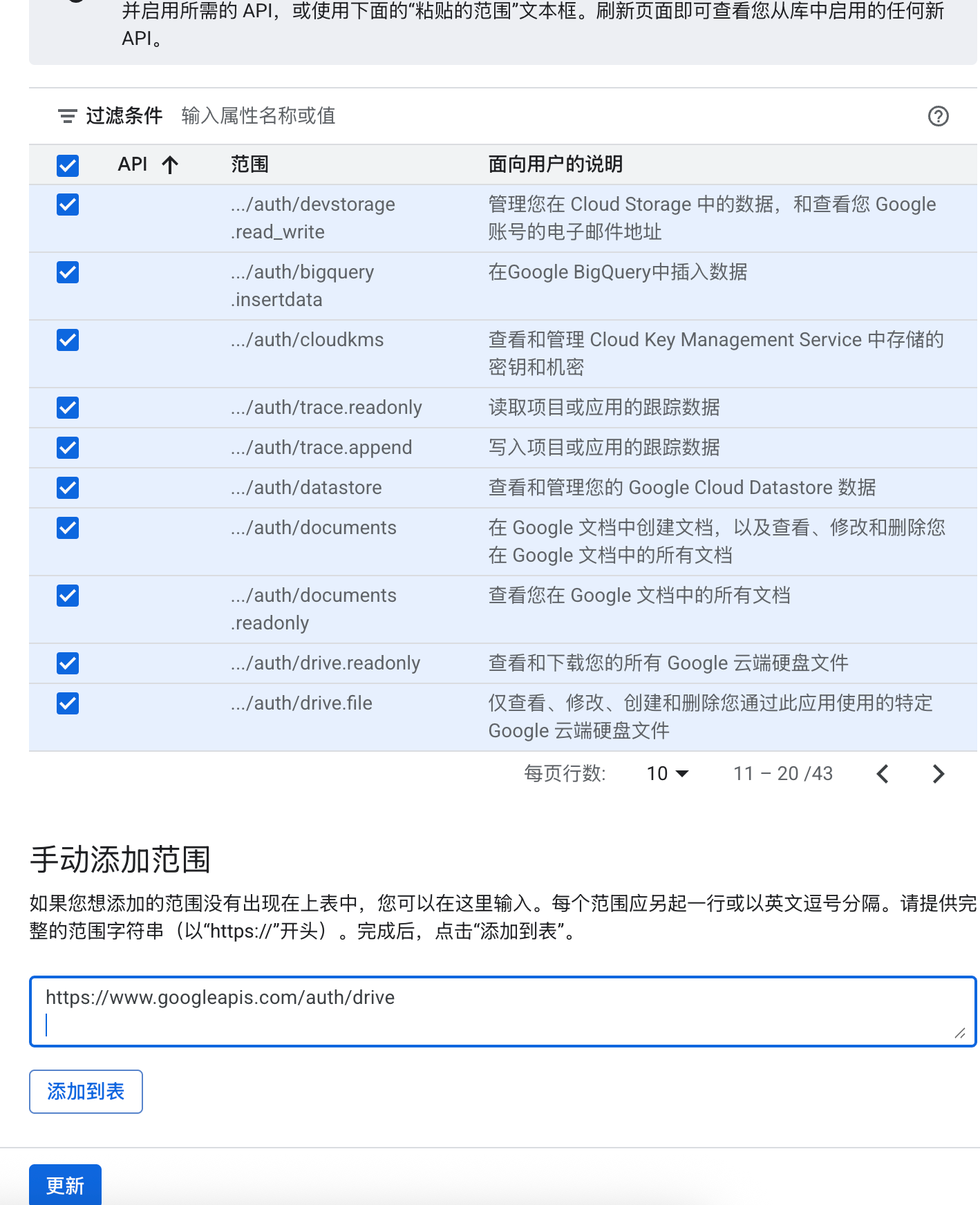

然后在数据访问中添加权限 -

缺少的权限加在这里(如图),https://www.googleapis.com/auth/drive

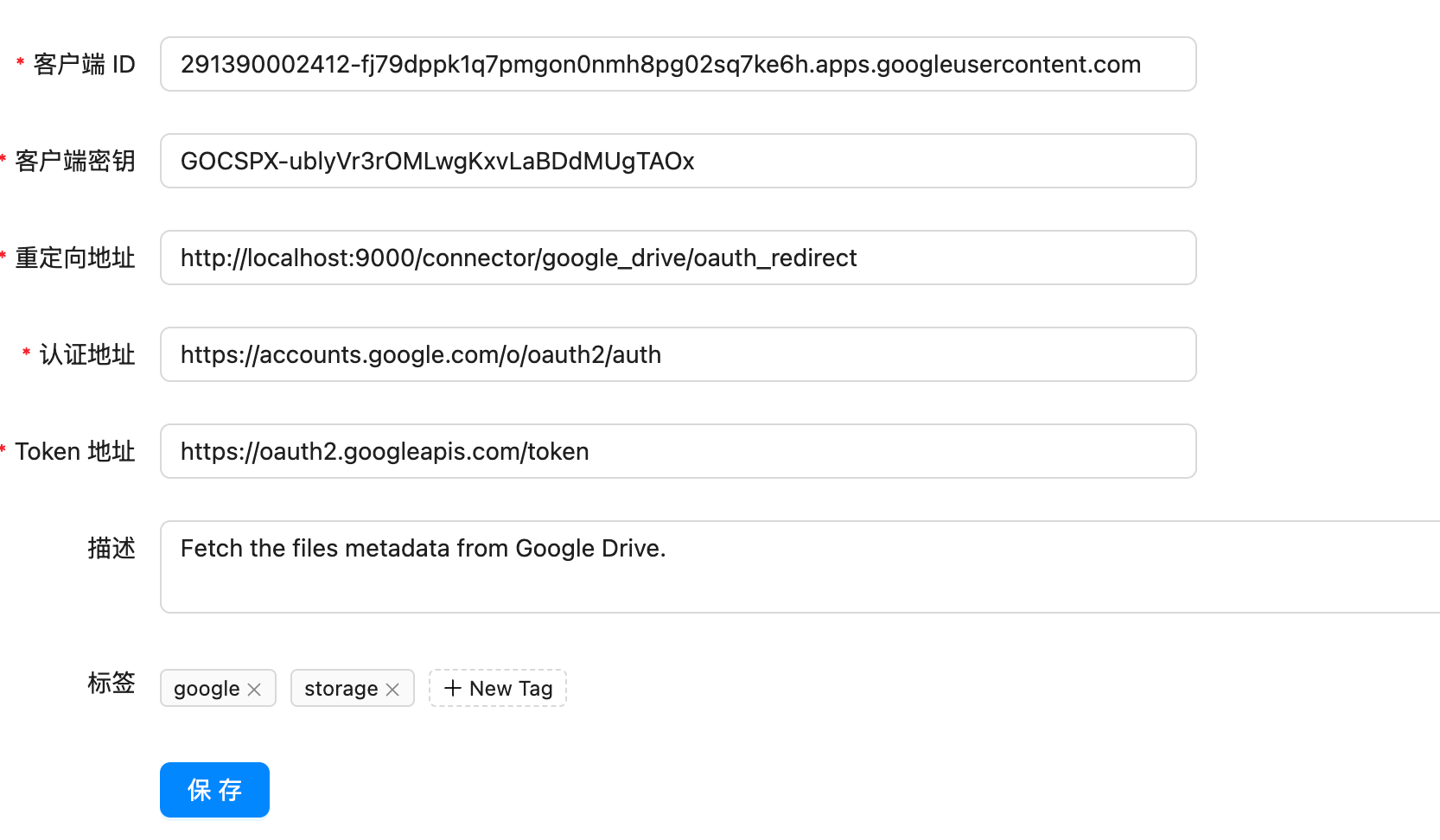

在 coco-sever 更新 google drive 的信息

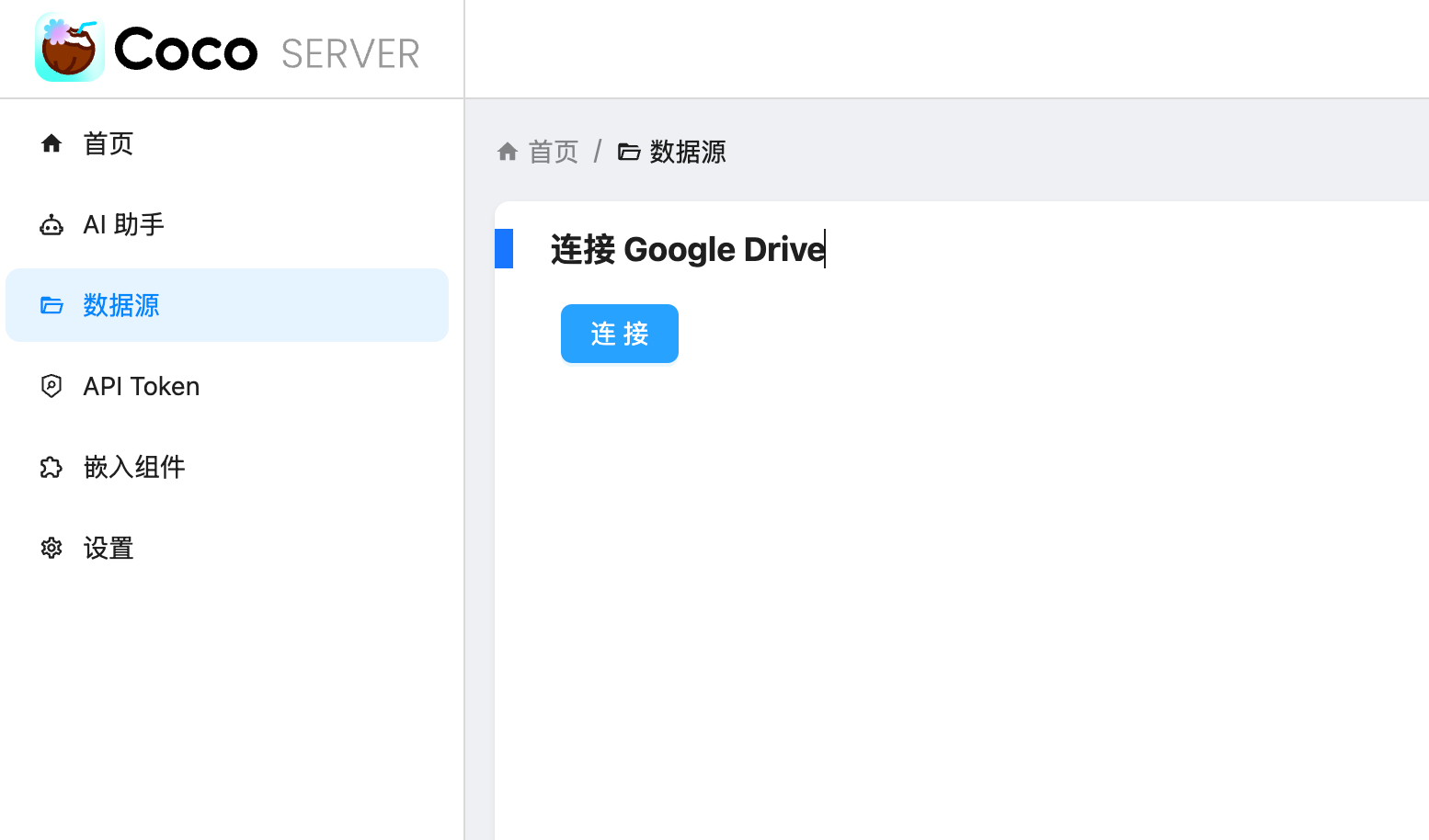

然后在 coco-server 中连接

跳转 google sso

由于是测试账户,所以会有这个弹窗,继续就好

再次进行测试

获取权限

显示登陆成功

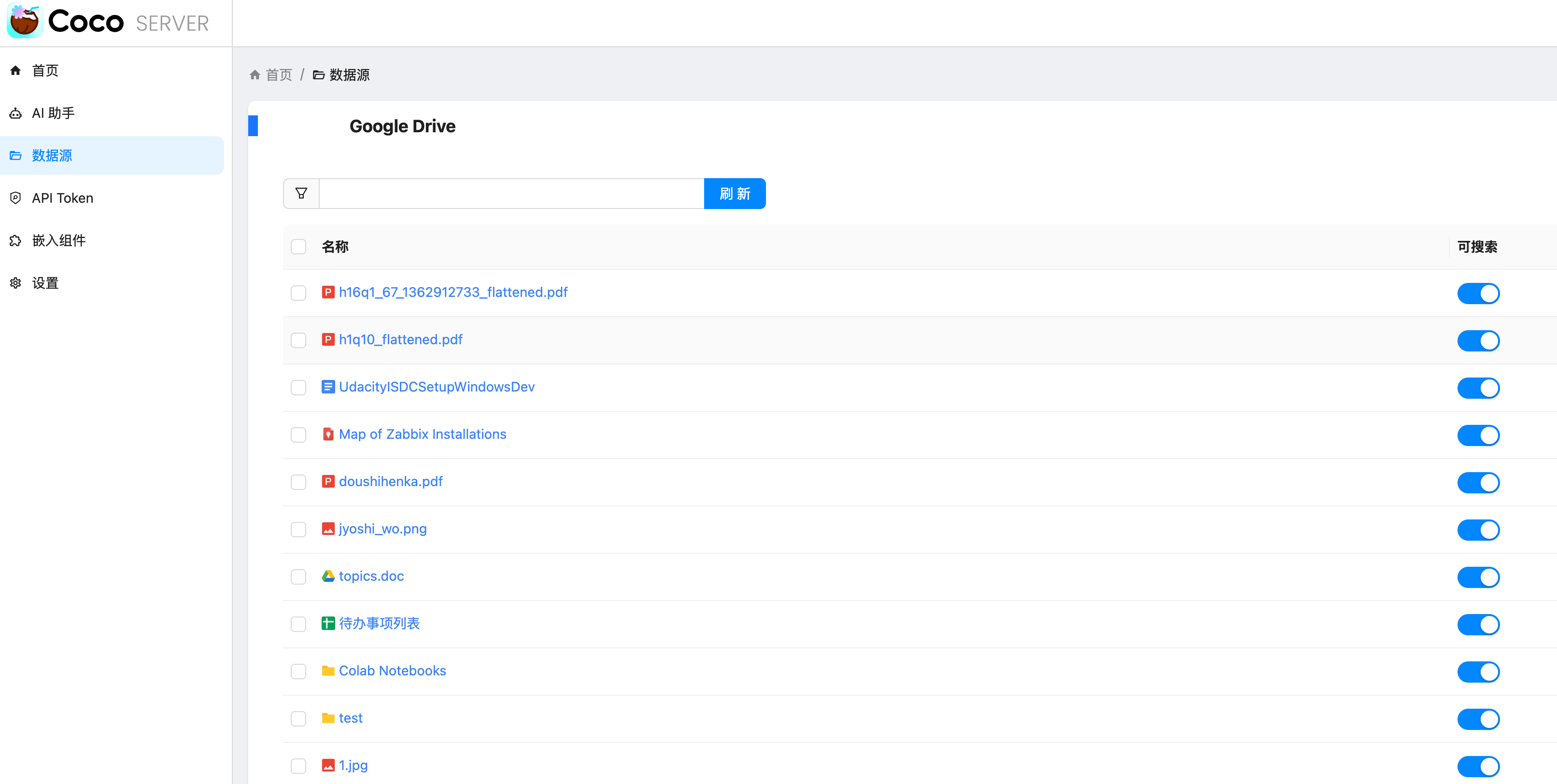

然后可以在数据源中看到对应数据

文章作者: 忘机山人

版权声明: 本博客所有文章除特别声明外,均采用 CC BY-NC 4.0 许可协议。转载请注明来源 镜湖!

相关推荐

2025-04-17

Coco-AI 集成语雀作为语料库进行检索

coco-AI 把语雀当作语料库做检索说在前面,这个功能需要在语雀后台申请 Personal Access Token。使用的需要超级会员的(不是邀请新用户给的专业会员),所以需要付费使用。 然后在语雀后台,也就是https://www.yuque.com/settings/tokens处可以看见申请token的地方,如果你没有超级会员,这个是没办法用的。 点击新建,创建 token 分发权限,我这边给了所以的权限,语雀和 Notion 不同,这里给了权限就够了,其他地方无需在给权限。(手动@Notion 还要在文档或者文件夹授权) 点击查看详情可以看到 token,这里的 token 是可以反复查看的,由此语雀这一侧的设置完毕。 回到 coco-AI,我这边使用的是这个镜像,这里添加了对个人版本语雀的支持。 1infinilabs/coco:0.3.2_NIGHTLY-20250417 启动命令如下: 1docker run -d --name cocoserver -p 9000:9000 infinilabs/coco:0.3.2_NIGHTLY-202504...

2025-08-28

不建 Hugo、不用 Hexo,纯 Markdown 文件也能接入 Coco-AI!

容器运行 Coco AI,如何访问宿主机的 localhost?使用容器确实方便了很多事情,但在网络访问上可能会引出一些麻烦。如果你的调试服务只监听在宿主机的 localhost,那么在容器里访问时,会找的是容器自己的 localhost,所以无法连通。 因为无论是 Coco server 还是 Console 都是服务端发送请求,所以我统一记录下来。 下面介绍几种在不同环境下的解决方案。 1. Mac 的 Orbstack在 Orbstack 环境中,可以使用 host.docker.internal 代替宿主机的 localhost。例如访问宿主机的 Hexo 服务(http://localhost:4000/atom.xml)时,直接这样写: 1http://host.docker.internal:4000/atom.xml host.docker.internal 会被解析到宿主机 IP,相当于容器内部的 “localhost”。 2. Linux 下单容器运行在 Linux 环境中,host.docker.internal 默认可能不可用,可以用以下方法: 方...

2025-03-11

Coco AI 全新升级:全图形化 RAG 配置,一键开启智能知识管理!

Coco AI 再升级,全图形化配置 RAG在《Coco AI APP 初体验:开启智能知识管理新篇章》和《打造智能语料库:通过 Coco AI Server 实现 Notion 笔记 RAG 检索功能》中,我介绍了 Coco AI 的第一个版本 ,我们我需要调用服务端的接口来手动添加数据源和配置登录信息,见那么在 0.2 的版本中,极限科技又开发了一个管理页面用来处理这些繁琐的信息。 同时这次更新也带来了全平台的支持,当然如果你愿意也可以自己编译源代码。 我们先来用 Docker 启动服务端,一行命令搞定,不需要再传递负载的命令行参数,也无需在启动 Easysearch。 1docker run -d --name cocoserver -p 9000:9000 infinilabs/coco:0.2.1-1998 服务启动在 9000 端口,那么在浏览器中打开欢迎页面: 创建账户,选择模型,和之前一样,我还是选择本地部署的 ollama 并且使用 deepseek 模型。 设置完成后我们看到主页面,我们的目的是添加数据源,这样就不用使用复杂的请求。 可以进一步设置...

2025-03-18

Coco AI 智能检索 Hugo Blog 集成指南

在此前的文章中,我们介绍了如何使用 Coco Server 连接 Notion,实现智能内容检索。本次,我们将进一步探索如何在 Coco Server 最新版本 中集成 Hugo Site,以便对 Hugo 站点 进行高效检索。 Coco Server 部署方式要在本地或服务器上运行 Coco Server,可以借助 Docker 进行快速部署。 1. 直接运行 Coco Server(默认配置)执行以下命令,快速启动 Coco Server(版本 0.2.2-2000): 1docker run -d --name cocoserver -p 9000:9000 infinilabs/coco:0.2.2-2000 此命令将在后台运行 Coco Server,并将 9000 端口 映射到本机,以便通过 Web UI 进行访问。 2. 启用数据持久化(推荐)如果希望数据在容器重启或删除后仍然保留,建议启用 数据持久化,操作步骤如下: (1)创建数据目录并设置权限12mkdir -p $(pwd)/cocoserver/{data,logs}sudo c...

2026-02-17

Docker启动Coco AI Server后,如何访问内置Easysearch

使用 Docker 启动 Coco AI 的时候会自带一个 Easysearch,我们使用连接器连接外部数据源的时候,就会把这个数据解析到 Easysearch 里。 但是默认的话,容器不会把这个 Easysearch 的端口映射出来,那就需要我们自己做些小的技巧:在官网的命令上修改一下,把 9200 端口先映射出来。 启动命令如下: 1234567docker run -d --name cocoserver \ -p 9000:9000 \ -p 9200:9200 \ -v coco_data_vol:/app/easysearch/data \ -v coco_config_vol:/app/easysearch/config \ -v coco_logs_vol:/app/easysearch/logs \ infinilabs/coco:0.10.0-2678 启动之后,可以使用 netstat 看到容器端口的情况。换句话说,这个自带的 Easysearch 把 9200 和 9300 的端口确实启动起来了,但默认只绑定在 127.0.0.1 上,...

2026-02-18

RK3566嵌入式开发板运行Coco AI Sever

之前在泰山派上运行了Easysearch,这次也想着是不是可以在泰山派开发板RK3566上运行Coco server,毕竟这板子功耗小,适合常开。 我的RK3566上是Armbian,但是没有配置网络环境,访问Dockerhub有问题,所以从Macbook 上下载玩,然后通过离线方式导成tar文件。我的镜像改了tag叫做cocoai-arm:test,你也可以不改。 1docker save -o cocoai-arm_test.tar cocoai-arm:test 然后通过SCP上传到RK3566的开发板 1234567scp cocoai-arm_test.tar lckfb@192.168.5.36:~** WARNING: connection is not using a post-quantum key exchange algorithm.** This session may be vulnerable to "store now, decrypt later" attacks.** The server may need to be ...

评论

公告

欢迎来到我的小站,这里是我的第二大脑和生活日常。

Coco AI